El miedo al reporte es el preludio de fallas operativas mayores.

El silencio que precede a la catástrofe

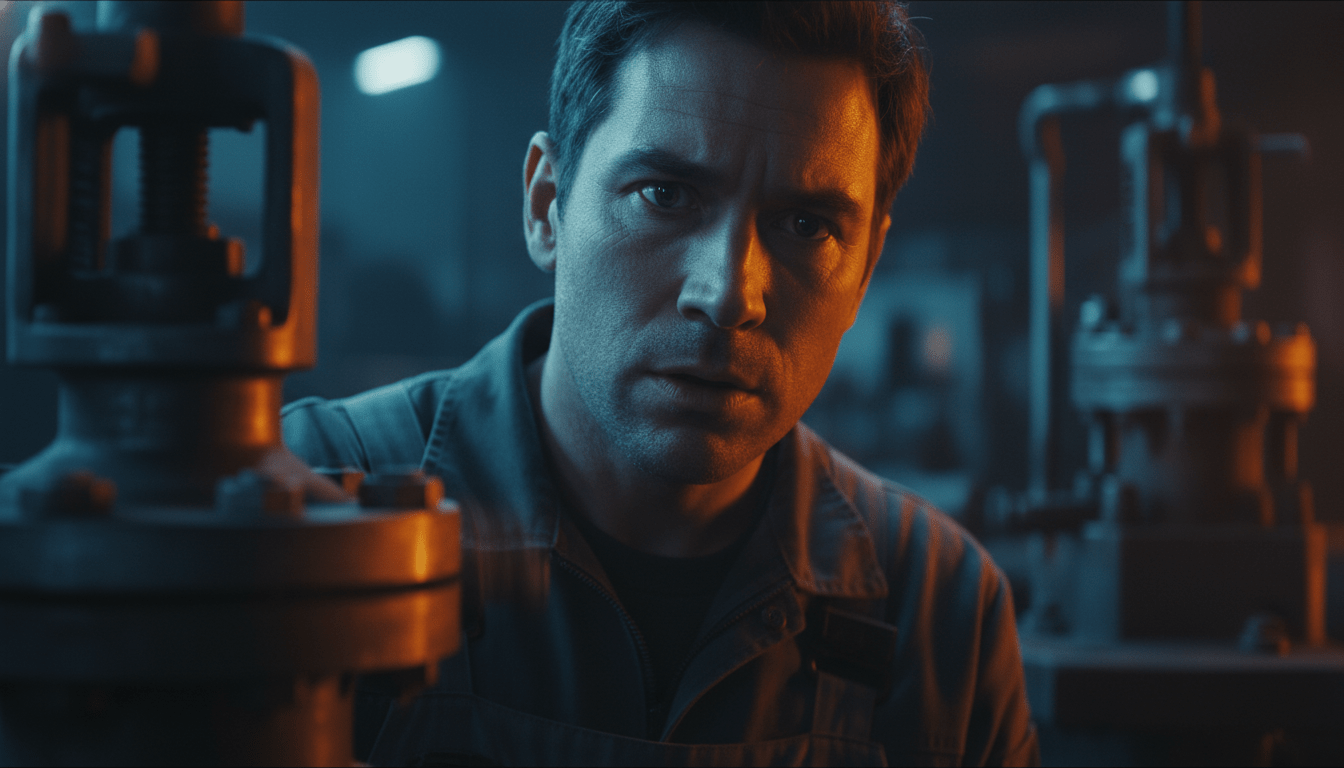

Imaginen por un momento una planta industrial en plena operación. Es el turno de noche. Un operario nota una vibración inusual en una válvula crítica. Sabe que, si lo reporta, tendrá que llenar un formulario extenso, será interrogado por supervisores que buscan a quién culpar y, posiblemente, su historial laboral se verá manchado por un ‘incidente’. Entonces, decide callar. Esa pequeña decisión, tomada en un segundo bajo el peso del miedo, es el origen de la mayoría de los accidentes que luego llamamos ‘tragedias inevitables’. La realidad es que el silencio de ese trabajador no es negligencia; es un mecanismo de defensa ante un sistema que ha aprendido a castigar en lugar de comprender.

La seguridad no es simplemente la ausencia de accidentes; es la presencia de capacidades organizativas. Cuando una empresa se obsesiona con encontrar al culpable, está sembrando las semillas de su propia destrucción operativa. La cultura de la culpa es un parásito que devora la información valiosa. En este artículo, vamos a diseccionar la anatomía de la ‘cultura justa’ (o just culture), un concepto que a menudo se malinterpreta como ‘no culpar a nadie’, cuando en realidad es el sistema más sofisticado de rendición de cuentas que existe.

La trampa de la culpa: por qué nuestro cerebro prefiere castigar

El ser humano tiene una inclinación evolutiva hacia la atribución de causalidad. Cuando algo sale mal, nuestro cerebro busca inmediatamente un agente responsable. Es un atajo cognitivo. Si un vaso se rompe, alguien lo tiró. Si un sistema de seguridad falla, alguien no siguió el procedimiento. Este sesgo, conocido en psicología como el error fundamental de atribución, nos lleva a sobreestimar el papel de la personalidad o las decisiones individuales y subestimar el contexto sistémico.

En el entorno industrial, este sesgo se institucionaliza. Cuando un gerente pregunta ‘¿quién cometió el error?’, está cerrando la puerta al aprendizaje. La investigación de incidentes se convierte en un juicio en lugar de una autopsia técnica. Al castigar al individuo, la organización envía un mensaje claro al resto de la plantilla: ‘si te equivocas, ocúltalo’. Y así, los errores se esconden, se acumulan en las sombras del sistema y, eventualmente, se manifiestan como fallos catastróficos que la gerencia no vio venir porque nadie les avisó.

Desmitificando la cultura justa: más allá del ‘no-blame’

Existe una confusión peligrosa en la industria: creer que la cultura justa es lo mismo que la cultura ‘sin culpa’. Nada más lejos de la realidad. Una cultura sin culpa sería un caos absoluto, donde las acciones temerarias y la negligencia deliberada quedarían impunes. Una verdadera cultura justa es, en esencia, un equilibrio refinado entre el aprendizaje y la responsabilidad.

La diferencia fundamental

La diferencia radica en el enfoque. En una cultura de culpa, la pregunta es: ‘¿A quién castigamos?’. En una cultura justa, la pregunta es: ‘¿Qué condiciones en el sistema permitieron que esta persona tomara una decisión que resultó en un error?’.

La cultura justa reconoce tres tipos de comportamientos que requieren respuestas distintas:

- El error humano: Un desliz, un lapsus de memoria, una distracción. Es inherente a la condición humana. No se castiga, se analiza para mejorar el diseño de la tarea.

- La conducta de riesgo: Cuando un trabajador toma un atajo porque el sistema es demasiado lento o complejo. Esto indica un fallo de diseño o de gestión. Se corrige ajustando los procesos.

- La conducta temeraria o negligencia deliberada: Cuando un individuo elige ignorar las normas de seguridad de forma consciente y malintencionada. Aquí sí debe haber una respuesta disciplinaria, porque la seguridad es un contrato social que todos deben respetar.

La arquitectura de la confianza: cómo fomentar el reporte

Fomentar una cultura donde la gente se sienta cómoda reportando sus propios errores es, posiblemente, el desafío más grande para cualquier líder de seguridad. No se logra con carteles motivacionales ni con un buzón de sugerencias anónimo. Se logra con coherencia.

El papel crítico del liderazgo

El liderazgo debe ser el primero en admitir vulnerabilidad. Si un gerente nunca admite un error, nadie más lo hará. La cultura se filtra de arriba hacia abajo. Cuando un directivo dice ante el equipo: ‘Cometí un error en la planificación de esta tarea y he aprendido esto…’, está validando el comportamiento de honestidad. La transparencia es una moneda de cambio: si quieres que te entreguen información valiosa, debes pagar con confianza.

Sistemas de reporte accesibles y transparentes

El sistema de reporte debe ser tan fácil de usar como pedir un café. Si el proceso de reporte implica diez páginas de burocracia, nadie lo hará. Además, la retroalimentación es vital. Si un trabajador reporta un ‘casi accidente’ y nunca recibe noticias sobre qué se hizo al respecto, el sistema muere. El reporte debe generar una respuesta visible. Ver que su contribución ha cambiado un proceso, una herramienta o una política es la mayor recompensa para un empleado.

Estudios de caso y lecciones aprendidas

La aviación comercial ha sido pionera en este campo. En los años 70, la industria aérea reconoció que la mayoría de los accidentes eran causados por errores humanos en sistemas complejos. Implementaron el concepto de Crew Resource Management (CRM) y sistemas de reporte voluntarios (como el ASRS en Estados Unidos). El resultado fue una reducción drástica de la tasa de accidentes. Hoy, volar es una de las actividades más seguras gracias a que los pilotos reportan sus errores sin miedo a perder sus licencias.

En el sector sanitario, la transición ha sido más lenta y dolorosa. Médicos y enfermeras operan bajo una presión extrema donde el error puede costar una vida. Sin embargo, los hospitales que han adoptado la cultura justa han visto cómo la tasa de mortalidad por errores médicos disminuye, no porque el personal sea más inteligente, sino porque los procesos de comunicación y verificación se han vuelto más robustos.

Análisis crítico: los desafíos de la implementación

Implementar una cultura justa no es un proyecto de tres meses; es una transformación cultural que puede durar años. El principal obstáculo es la resistencia del ‘viejo guardia’. Siempre habrá gerentes o supervisores que crean que el miedo es la única forma de mantener el control. Convencer a estos perfiles requiere datos, no retórica. Debemos mostrarles cómo el miedo oculta los problemas que, a largo plazo, son mucho más costosos que el error humano que intentan castigar.

Otro desafío es la frontera entre el error y la negligencia. ¿Dónde termina el ‘lapsus’ y empieza la ‘temeridad’? Esta línea debe ser definida colectivamente. Involucrar a los trabajadores en la creación de las políticas disciplinarias hace que las reglas sean sentidas como justas, no como impuestas. Cuando los empleados ayudan a definir qué comportamientos son inaceptables, la cultura de seguridad se vuelve autorregulada.

Hacia una organización de aprendizaje continuo

Una organización que no aprende de sus errores está condenada a repetirlos. La cultura justa es la base de una ‘organización de alta fiabilidad’. En estas organizaciones, la seguridad no es una prioridad (las prioridades cambian), es un valor central. La seguridad es la forma en que hacemos las cosas aquí, todo el tiempo.

El cambio de paradigma implica dejar de ver los incidentes como ‘fallos’ y empezar a verlos como ‘fuentes de datos’. Cada error es un regalo, una pieza de información gratuita que el sistema nos entrega sobre sus propias debilidades. Desperdiciar esa información castigando al portador es el acto más antieconómico que una empresa puede cometer.

Preguntas frecuentes (FAQs)

¿Es la cultura justa lo mismo que la impunidad?

Absolutamente no. La cultura justa no significa que no haya consecuencias. Significa que las consecuencias se aplican basándose en la naturaleza del comportamiento (error, riesgo, negligencia) y no en el resultado del incidente. Los actos de negligencia grave o intencional siguen siendo sancionados, pero los errores honestos se utilizan como oportunidades de aprendizaje y mejora sistémica.

¿Qué hago si mi empresa tiene una cultura de miedo muy arraigada?

El cambio debe empezar desde los niveles donde tengas influencia. Si eres un supervisor, protege a tu equipo y sé transparente con tus propios errores. Documenta los beneficios de la apertura en tus informes. El cambio cultural suele comenzar como un movimiento de base que, con el tiempo, obliga a la alta dirección a reconocer que el enfoque punitivo es ineficiente y costoso.

¿Cómo distingo entre un error humano y un acto negligente?

La clave es el análisis del contexto. Pregúntate: ¿El trabajador tenía la formación necesaria? ¿El sistema le proporcionó las herramientas adecuadas? ¿Estaba bajo fatiga extrema? ¿Hubo presión de tiempo impuesta por la gerencia? Un error humano suele ocurrir a pesar de la intención de hacer bien las cosas. La negligencia implica una elección consciente de ignorar los riesgos, a menudo sabiendo las consecuencias.