El fuego de la inteligencia artificial: una herramienta poderosa con riesgos invisibles para la seguridad corporativa.

El dilema de Prometeo en la oficina moderna

La adopción de la inteligencia artificial generativa en el entorno corporativo no es simplemente una actualización de software; es un cambio de paradigma que recuerda al descubrimiento del fuego. Por un lado, tenemos una herramienta capaz de iluminar procesos, acelerar la creatividad y reducir semanas de trabajo a meros segundos. Por otro, nos enfrentamos a un incendio potencial que puede consumir la propiedad intelectual, la privacidad de los datos y la reputación de una marca en un abrir y cerrar de ojos. La seguridad corporativa ya no se limita a poner un firewall o gestionar contraseñas; ahora se trata de entender la arquitectura misma del pensamiento sintético y cómo este interactúa con los activos más valiosos de una organización.

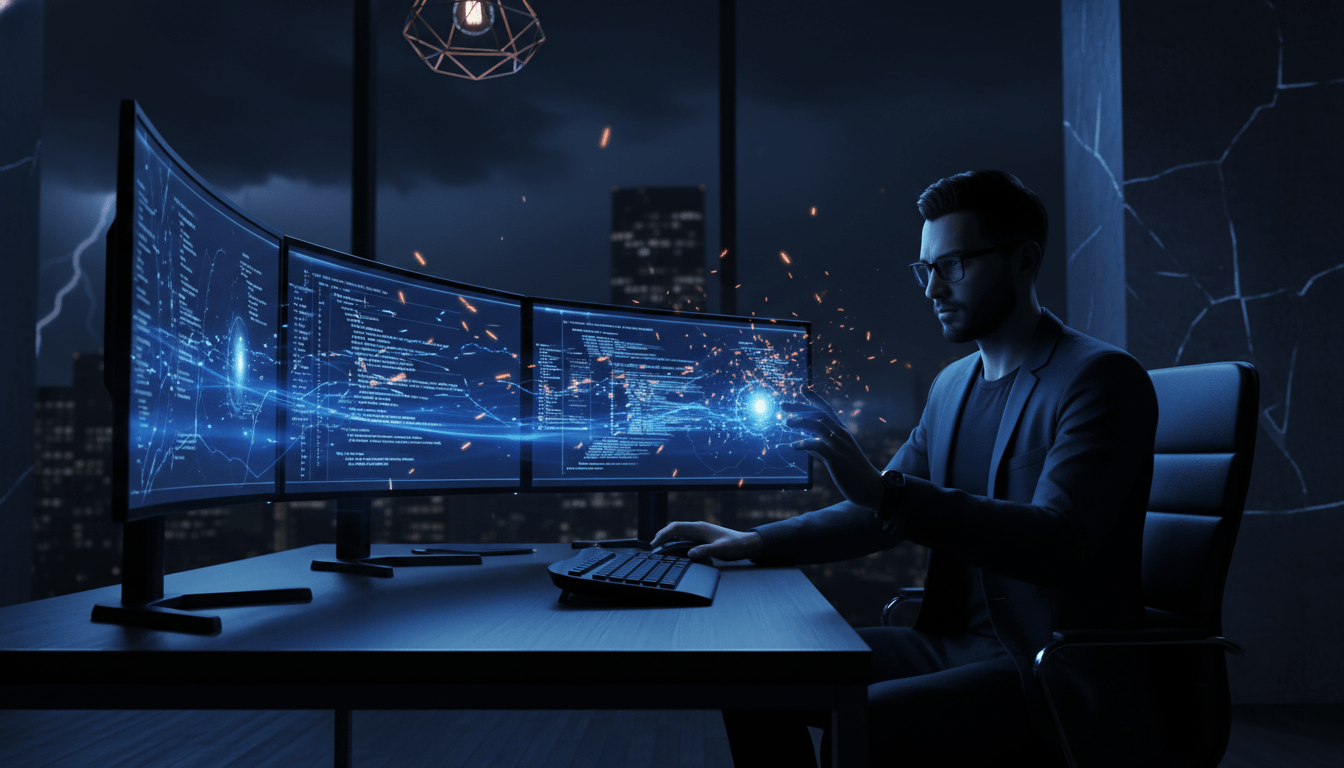

Imaginen por un momento a un ingeniero de software brillante que, frustrado por un error persistente en un código crítico, decide copiar y pegar ese fragmento en un chatbot de acceso público para buscar una solución. En ese preciso instante, sin que medie una intención maliciosa, ese código —que podría contener secretos comerciales o vulnerabilidades de seguridad— ha salido del perímetro controlado de la empresa para alojarse en los servidores de un tercero, donde será utilizado para entrenar futuras iteraciones del modelo. Este no es un escenario hipotético; es la realidad cotidiana de lo que llamamos Shadow AI o IA en la sombra. El riesgo no reside únicamente en el atacante externo que intenta derribar la puerta, sino en la porosidad de las herramientas que nuestros propios empleados utilizan para ser más eficientes.

La anatomía de la vulnerabilidad: ¿dónde sangran las empresas?

Para proteger una organización, primero debemos mapear las grietas por donde se escapa la seguridad. No todos los riesgos de la IA generativa son iguales ni afectan de la misma manera. Podemos dividirlos en tres grandes pilares: la integridad de los datos, la veracidad de la información y la ingeniería social avanzada.

El drenaje silencioso de la propiedad intelectual

El primer gran riesgo es la fuga de información sensible. Los modelos de lenguaje extensos (LLM) funcionan como esponjas. Cuando un empleado interactúa con una versión gratuita o no empresarial de estas herramientas, los datos introducidos suelen pasar a formar parte del corpus de entrenamiento del proveedor. Esto significa que la estrategia de marketing para el próximo año, los datos financieros no publicados o los algoritmos propietarios podrían acabar siendo sugeridos a un competidor que haga la pregunta adecuada al mismo chatbot meses después. La administración de seguridad debe establecer políticas claras sobre qué tipo de información puede ser procesada por herramientas externas y, preferiblemente, invertir en instancias privadas de estos modelos donde los datos no se utilicen para reentrenamiento.

Alucinaciones y el riesgo de la desinformación técnica

Otro peligro latente es la tendencia de la IA a alucinar. En el contexto de la seguridad empresarial, una alucinación no es solo un dato curioso erróneo; puede ser una instrucción de código insegura o un consejo legal equivocado que lleve a la empresa a incumplir normativas como el RGPD. Si un equipo de desarrollo confía ciegamente en las sugerencias de una IA para parchear una vulnerabilidad, y esa IA inventa una biblioteca de software que en realidad es un paquete malicioso (un ataque conocido como AI Package Hallucination), la empresa está abriendo la puerta de par en par al malware. La supervisión humana, o Human-in-the-loop, no es opcional; es el último bastión de defensa contra la creatividad errática de las máquinas.

Ingeniería social 2.0: el fin de la confianza visual y auditiva

Históricamente, la seguridad se basaba en la verificación de identidad. Sabías que hablabas con tu jefe porque reconocías su voz o lo veías en una videollamada. La IA generativa ha pulverizado esa certeza. Los deepfakes de audio y video son ahora tan sofisticados que pueden engañar incluso a ojos y oídos entrenados. Hemos visto casos documentados donde empleados de departamentos financieros han transferido millones de euros tras recibir una videollamada de su supuesto CEO, que en realidad era una recreación sintética en tiempo real.

La protección aquí no es técnica, sino procedimental. Las empresas deben implementar protocolos de autenticación fuera de banda para cualquier transacción o movimiento de datos sensible. Esto implica que, independientemente de quién parezca estar en la pantalla, se requiere un código de verificación enviado por un canal distinto o una frase de seguridad acordada previamente. La tecnología ha avanzado tanto que la única forma de combatirla es volviendo a métodos de verificación analógicos o multifactoriales extremadamente rigurosos.

Estrategias de blindaje: de la prohibición a la gobernanza inteligente

Intentar prohibir la IA generativa en una empresa es como intentar prohibir el uso de internet en los años 90: una batalla perdida que solo fomentará el uso clandestino y más arriesgado. La solución reside en la gobernanza. Una administración de seguridad moderna debe crear un Marco de Gestión de Riesgos de IA (AI RMF). Este marco debe empezar por una auditoría de herramientas: ¿qué se está usando?, ¿quién lo usa? y ¿para qué?

Implementación de entornos controlados

La medida más efectiva es proporcionar a los empleados alternativas seguras. En lugar de dejar que usen versiones públicas, la empresa debe desplegar APIs empresariales con acuerdos de privacidad de datos (Data Processing Agreements) que garanticen que la información no saldrá del entorno corporativo ni se usará para entrenar modelos ajenos. Es una inversión económica, sí, pero el coste de una brecha de datos o de la pérdida de una patente es infinitamente superior.

El papel de la educación y la cultura de seguridad

El eslabón más débil sigue siendo el humano, pero también puede ser el sensor más agudo. La formación en alfabetización de IA (AI Literacy) debe ser obligatoria. Los empleados necesitan entender no solo cómo usar las herramientas, sino cómo funcionan por dentro. Deben saber que un LLM no es una enciclopedia, sino un predictor estadístico de palabras. Al desmitificar la tecnología, reducimos la confianza ciega y fomentamos un pensamiento crítico que es vital para detectar anomalías o intentos de phishing generado por IA.

El laberinto legal y el cumplimiento normativo

No podemos ignorar el panorama legislativo. Con la llegada de normativas como la Ley de IA de la Unión Europea, las empresas enfrentan responsabilidades legales directas sobre cómo utilizan estos sistemas. Si tu empresa utiliza IA para filtrar currículums o evaluar el desempeño de los empleados, podrías estar incurriendo en sesgos algorítmicos que derivarán en demandas por discriminación. La seguridad empresarial ahora incluye una dimensión ética y legal que requiere la colaboración estrecha entre los departamentos de IT, Legal y Recursos Humanos.

Es imperativo realizar evaluaciones de impacto (Algorithmic Impact Assessments) para entender cómo las decisiones tomadas por una IA pueden afectar a terceros. La transparencia no es solo una buena práctica ética; es un escudo legal. Documentar cada paso de la implementación de la IA, desde la selección del modelo hasta las pruebas de seguridad (red teaming), será la diferencia entre una gestión exitosa y un desastre corporativo ante una auditoría.

Hacia una resiliencia proactiva

La seguridad en la era de la IA generativa no es un estado estático, sino un proceso de adaptación continua. Las amenazas evolucionan a la misma velocidad que los modelos. Hoy nos preocupamos por las fugas de datos; mañana, quizás, por agentes autónomos de IA que tomen decisiones financieras sin supervisión. La clave está en la agilidad. Las empresas que sobrevivan y prosperen no serán las que más se resistan al cambio, sino las que construyan infraestructuras lo suficientemente flexibles para integrar la innovación mientras mantienen un control férreo sobre sus fronteras digitales.

Debemos ver la seguridad no como un freno, sino como el sistema de frenado de un coche de carreras: su existencia es precisamente lo que permite al vehículo ir más rápido con confianza. Al proteger los datos, verificar las identidades y educar a las personas, estamos permitiendo que la inteligencia artificial sea el motor de crecimiento que prometía ser, sin que el viaje termine en un accidente catastrófico para la organización.

Preguntas Frecuentes (FAQs)

¿Es seguro usar las versiones gratuitas de chatbots para tareas de oficina cotidianas?

En términos generales, no es recomendable para ninguna tarea que involucre datos que no sean públicos. La mayoría de las versiones gratuitas de herramientas de IA generativa utilizan los prompts de los usuarios para entrenar sus modelos. Esto significa que cualquier información confidencial, estratégica o técnica que introduzcas deja de estar bajo tu control y podría ser expuesta indirectamente a otros usuarios en el futuro. Para uso profesional, siempre se deben preferir las versiones Enterprise que garantizan la privacidad de los datos.

¿Cómo puedo detectar si un correo electrónico o una llamada es un deepfake generado por IA?

Detectar deepfakes de alta calidad a simple vista es cada vez más difícil. Sin embargo, en el caso del audio, a veces se pueden notar cadencias poco naturales o falta de ruidos de fondo coherentes. La mejor defensa no es la detección visual o auditiva, sino la verificación procedimental. Establecer canales secundarios de confirmación (como llamar a un número conocido o usar una clave interna) es la única forma segura de validar una identidad en situaciones de riesgo financiero o de seguridad.

¿Qué debería incluir una política básica de uso de IA en mi empresa?

Una política sólida debe definir claramente qué herramientas están autorizadas, qué niveles de clasificación de datos pueden introducirse en cada una (por ejemplo, prohibir datos de clientes en herramientas externas) y la obligatoriedad de la revisión humana para cualquier resultado generado por la IA. Además, debe incluir directrices sobre la transparencia, obligando a los empleados a declarar cuándo un contenido ha sido generado o asistido por inteligencia artificial, especialmente en comunicaciones externas o informes legales.