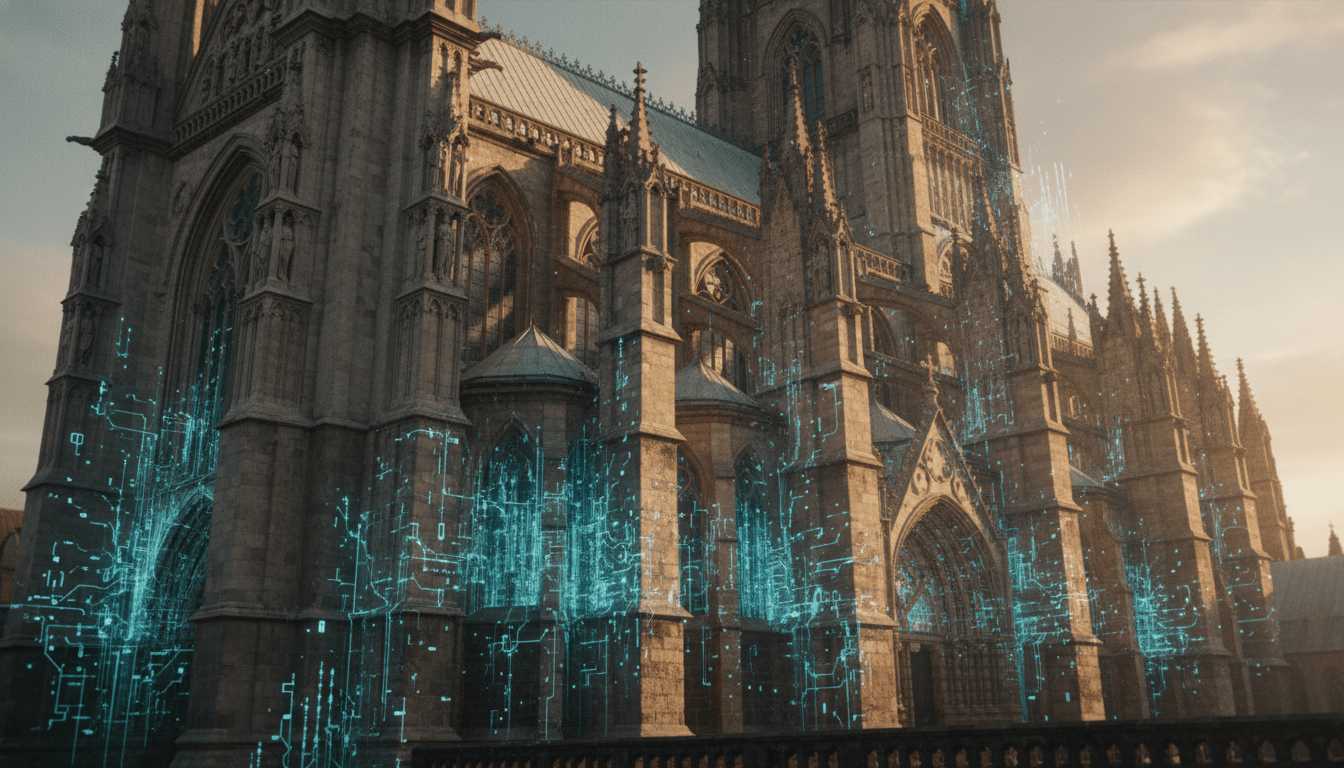

La ciberseguridad es como una catedral: un pequeño error de cálculo en los cimientos puede comprometer toda la estructura.

El origen invisible de nuestra fragilidad digital

Imaginemos por un momento la construcción de una catedral gótica. Cada piedra, cada contrafuerte, cada arco apuntado ha sido calculado con precisión matemática. Sin embargo, si en el plano original existe un error de cálculo minúsculo —apenas un par de milímetros en la inclinación de una columna—, ese fallo no es evidente al principio. El edificio se mantiene en pie, cumple su función y recibe a miles de visitantes. Pero, con el tiempo, bajo la presión del peso y las inclemencias del clima, esa pequeña desviación comienza a ceder. En el mundo del software, este fenómeno es lo que llamamos un bug. Es la imperfección inherente a la creación humana, una grieta en la lógica del código que, aunque invisible para la mayoría, define la arquitectura de nuestra seguridad digital.

A menudo, en las conversaciones cotidianas sobre tecnología, utilizamos los términos bug y exploit como si fueran sinónimos. Escuchamos decir que alguien ha sufrido un ataque debido a un bug, cuando en realidad, lo que ha ocurrido es una explotación. Esta confusión no es trivial; es una falta de entendimiento fundamental que nos deja expuestos. Para comprender la ciberseguridad moderna, debemos separar ambos conceptos: el bug es el error de diseño o implementación, mientras que el exploit es la llave maestra que un atacante fabrica para abrir esa puerta específica.

La naturaleza del bug: cuando la lógica se tuerce

Un bug de software es, en su esencia más pura, una discrepancia entre lo que el programador pretendía que hiciera el código y lo que realmente hace. No siempre es un acto de malicia; de hecho, la gran mayoría son errores humanos, omisiones o malentendidos de la complejidad del sistema. Es importante desmitificar la idea de que un bug es siempre un error de sintaxis evidente. A veces, el código está sintácticamente perfecto, pero lógicamente roto.

Tomemos como ejemplo la famosa historia de la sonda Mariner 1 en 1962. La NASA perdió una misión multimillonaria hacia Venus debido a la omisión de un guion en una línea de código Fortran. Ese guion era la diferencia entre una corrección de trayectoria necesaria y una orden de autodestrucción. Ese es un bug clásico: una pieza de lógica que, al fallar, altera catastróficamente el resultado final. Pero en el contexto actual, los bugs no solo causan fallos operativos; crean vulnerabilidades. Un desbordamiento de búfer, por ejemplo, ocurre cuando un programa intenta escribir más datos en un espacio de memoria de los que este puede contener. Es como intentar verter un litro de agua en un vaso de 200 mililitros; el exceso termina derramándose en otros lugares de la memoria, corrompiendo datos o, en el peor de los casos, permitiendo la ejecución de código arbitrario.

El exploit: la herramienta del oportunista

Si el bug es la grieta en el muro, el exploit es la ganzúa diseñada específicamente para esa grieta. Un exploit no es el error en sí, sino el mecanismo técnico o el código malicioso creado para aprovecharse de esa debilidad. Imagina que descubres que la cerradura de tu puerta principal tiene un defecto de fábrica que permite abrirla con una tarjeta de crédito. La cerradura defectuosa es el bug. El acto de deslizar la tarjeta con el ángulo preciso para abrir la puerta es el exploit. Sin el exploit, la vulnerabilidad podría permanecer latente durante años, ignorada y sin consecuencias graves.

La industria del ciberdelito ha profesionalizado la creación de exploits. Existen mercados negros, y también mercados legales de investigación, donde se cotizan estas herramientas. Un exploit de día cero (zero-day) es el santo grial para un atacante. Se denomina así porque, desde el momento en que se utiliza, el desarrollador tiene cero días para reaccionar. No hay parche, no hay defensa, no hay aviso previo. El atacante posee una ventaja absoluta sobre el defensor, operando en un terreno donde las reglas de juego aún no se han escrito.

Anatomía de una vulnerabilidad: del error al desastre

Para entender cómo un simple bug se convierte en una brecha de seguridad masiva, debemos analizar el ciclo de vida de una vulnerabilidad. Todo comienza con la complejidad. Los sistemas modernos, como los que utilizamos en la nube o en nuestros dispositivos móviles, son capas sobre capas de abstracción. Cada capa añade una nueva superficie de ataque.

- Fase de descubrimiento: Investigadores de seguridad o actores maliciosos analizan el código en busca de comportamientos inesperados.

- Fase de análisis: Se evalúa si el bug tiene potencial para ser explotado. No todos los bugs son vulnerabilidades. Algunos solo causan que una aplicación se cierre, lo cual es molesto pero no necesariamente explotable para obtener acceso.

- Fase de desarrollo del exploit: Aquí es donde la ingeniería inversa entra en juego. El atacante escribe el código que manipulará el bug para ejecutar sus objetivos (robar datos, escalar privilegios, instalar malware).

- Fase de explotación: El código malicioso se despliega contra el objetivo.

Este proceso no es lineal. En muchos casos, los atacantes encadenan múltiples bugs. Por ejemplo, pueden usar un bug menor para obtener acceso a un sistema con privilegios limitados, y luego encadenarlo con otro bug de escalada de privilegios para obtener el control total de la máquina. Esta es la realidad de las amenazas persistentes avanzadas (APT), donde el atacante no busca un solo error, sino que construye una escalera de fallos para alcanzar su objetivo.

El impacto económico y la crisis de calidad

No podemos hablar de bugs y exploits sin mencionar el costo. Se estima que la economía global pierde miles de millones de dólares anualmente debido a software defectuoso. Pero el costo no es solo financiero; es de confianza. Cuando un servicio bancario o una red de infraestructura crítica sufre un ataque basado en un exploit, la fe del usuario en la tecnología se erosiona. La crisis de calidad del software en 2025 ha demostrado que la carrera por lanzar productos al mercado a menudo sacrifica la seguridad en el altar de la velocidad.

Las empresas que priorizan el desarrollo ágil sin integrar la seguridad en el ciclo de vida del desarrollo (DevSecOps) están construyendo castillos de naipes. La deuda técnica, que es el costo acumulado de tomar atajos en el desarrollo, termina pagándose con intereses altísimos cuando un exploit sale a la luz. Es fundamental entender que la corrección de un bug en la fase de diseño cuesta una fracción de lo que cuesta parchear una vulnerabilidad una vez que el software ha sido desplegado y explotado en el mundo real.

Estrategias de defensa: más allá del parche

¿Qué podemos hacer frente a esta realidad? La solución no es simple, pero es necesaria. La defensa contra exploits no se basa solo en instalar actualizaciones. Se basa en una estrategia de defensa en profundidad.

La reducción de la superficie de ataque es el primer paso. Si un componente de software no es necesario, debe eliminarse. Si una función no se utiliza, debe desactivarse. Cuanto menos código se ejecute, menos espacio hay para que un bug se esconda. Además, el uso de herramientas modernas de análisis estático y dinámico de código ayuda a identificar bugs antes de que el software llegue a producción. Estas herramientas actúan como un control de calidad constante, señalando irregularidades que un ojo humano podría pasar por alto.

Por otro lado, la segmentación de redes y el principio de menor privilegio son vitales. Incluso si un atacante logra explotar un bug en un servicio, si ese servicio está aislado y no tiene permisos de administrador, el impacto del exploit se minimiza. El objetivo no es la invulnerabilidad total, lo cual es una quimera técnica, sino la resiliencia. Un sistema resiliente es aquel que puede recibir un golpe, contener el daño y recuperarse rápidamente.

Preguntas Frecuentes (FAQs)

¿Es posible que un software no tenga bugs?

En términos prácticos, no. Cualquier software de complejidad moderada tiene bugs. La cantidad de líneas de código en los sistemas operativos modernos es astronómica, y la interacción entre diferentes componentes es tan compleja que es matemáticamente imposible garantizar la ausencia total de errores. La meta no es eliminar todos los bugs, sino gestionar el riesgo y asegurar que los bugs críticos sean detectados y corregidos antes de que puedan ser explotados.

¿Qué diferencia hay entre un exploit y un malware?

Esta es una distinción crucial. El exploit es el vehículo o la técnica; el malware es la carga útil. Imagina un ladrón que usa una ganzúa (exploit) para abrir una puerta y entrar en una casa. Una vez dentro, roba joyas o instala una cámara espía (malware). El exploit es la herramienta que le permite entrar, mientras que el malware es el daño que causa una vez que ha obtenido acceso. A menudo, un exploit se utiliza para entregar y ejecutar el malware en el sistema de la víctima.

¿Por qué los parches tardan tanto en salir a veces?

Desarrollar un parche no es simplemente cambiar una línea de código. Una vez que se identifica un bug, los desarrolladores deben entender la causa raíz, desarrollar una solución, probar esa solución para asegurarse de que no rompa otras partes del software (lo que se conoce como regresión) y luego desplegarla de manera segura a millones de usuarios. En sistemas críticos, este proceso debe ser extremadamente riguroso, lo que inevitablemente consume tiempo.