La computacion neuromorfica imita el cerebro humano para revolucionar la seguridad digital.

El amanecer de los cerebros de silicio y sus sombras digitales

Imagina un procesador que no piensa en unos y ceros constantes, sino que espera, en un silencio eléctrico, hasta que un estímulo lo hace disparar una señal. No es una CPU convencional, ni siquiera una GPU de última generación. Es un sistema neuromórfico, una arquitectura diseñada para imitar la eficiencia y la estructura del cerebro humano. Sin embargo, en el mundo de la seguridad de la computación neuromórfica, esta asombrosa capacidad de procesamiento trae consigo un conjunto de vulnerabilidades que harían palidecer a los expertos en ciberseguridad tradicional.

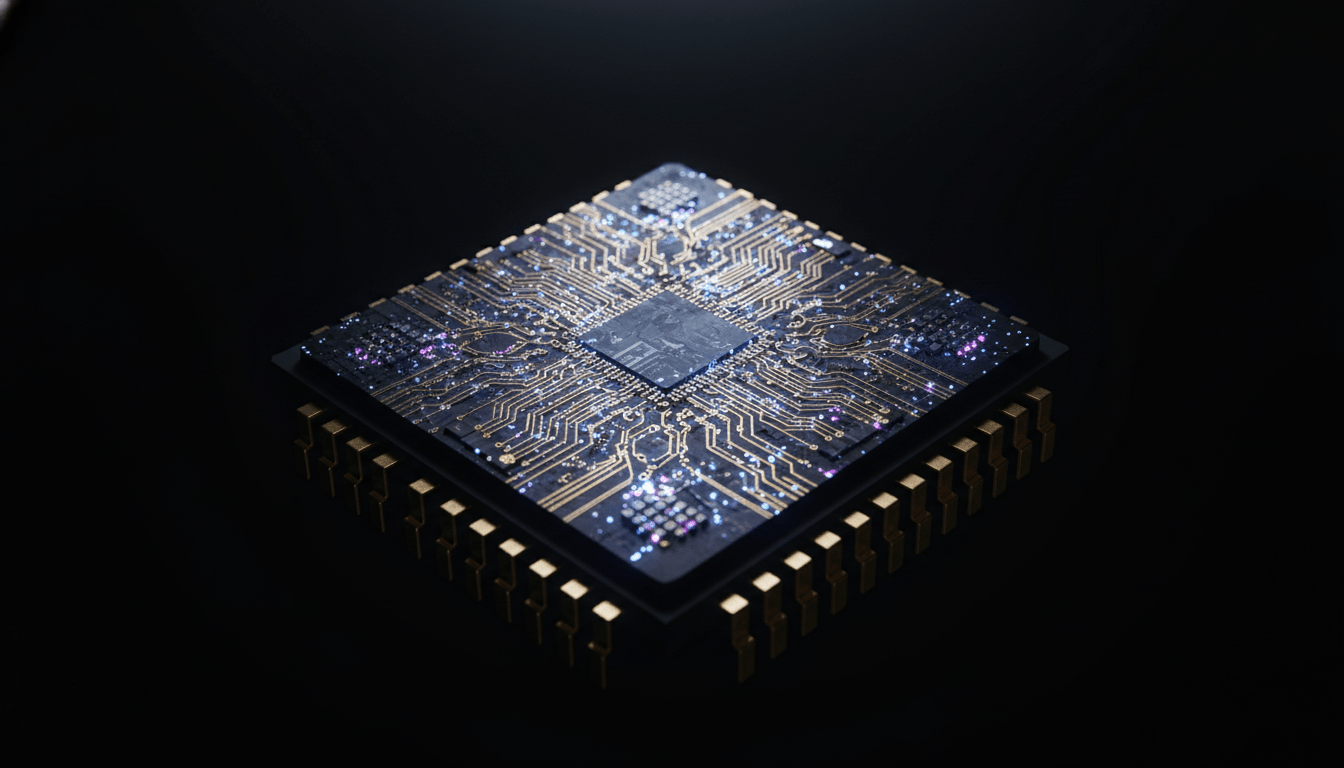

La computación neuromórfica se basa en Redes Neuronales de Impulsos (Spiking Neural Networks o SNN). A diferencia de la arquitectura de Von Neumann —donde la memoria y el procesador están separados, creando el famoso cuello de botella—, los chips neuromórficos como el Intel Loihi o el IBM TrueNorth integran ambos elementos. Esto permite una eficiencia energética sin precedentes, pero también abre la puerta a ataques que explotan la temporalidad y la física del hardware de formas que apenas estamos empezando a comprender.

Vulnerabilidades en el tejido de las neuronas artificiales

Cuando hablamos de proteger estos sistemas, no solo nos referimos a cortafuegos o cifrado de datos. La superficie de ataque en la computación neuromórfica es intrínsecamente física y temporal. Uno de los mayores riesgos reside en los ataques adversarios basados en impulsos (spikes). En una red neuronal tradicional, un atacante podría modificar píxeles de una imagen para engañar a una IA. En un sistema neuromórfico, el atacante manipula el timing de los impulsos eléctricos.

El peligro de la manipulación temporal

Dado que estos sistemas dependen de cuándo ocurre un evento, una perturbación de microsegundos en la señal de entrada puede alterar completamente el resultado de una clasificación. Imagina un vehículo autónomo que utiliza sensores de visión neuromórfica (DVS). Un atacante podría inyectar patrones de ruido electromagnético que el ojo humano no percibe, pero que el chip interpreta como una señal de frenado de emergencia o, peor aún, como una señal de vía libre cuando hay un obstáculo.

Estudios recientes en 2024 y 2025 han demostrado que las SNN son susceptibles a ataques de NeuroMimicry. En estos escenarios, el malware no busca corromper archivos, sino mimetizar los patrones de disparo de las neuronas legítimas para pasar desapercibido ante los sistemas de detección de anomalías. Es, literalmente, un infiltrado que aprende a hablar el idioma eléctrico del cerebro artificial para manipularlo desde dentro.

Ataques de canal lateral y la física del hardware

La seguridad de la computación neuromórfica también debe lidiar con la naturaleza analógica de muchos de sus componentes, como los memristores. Estos dispositivos permiten almacenar información variando su resistencia eléctrica, lo que es ideal para imitar sinapsis. Sin embargo, esta misma propiedad los hace vulnerables a ataques de canal lateral (Side-Channel Attacks).

- Análisis de consumo de energía: Debido a que el procesamiento es impulsado por eventos, el consumo de energía del chip fluctúa de manera exacta con la actividad neuronal. Un observador externo puede deducir qué está procesando el sistema simplemente midiendo estas variaciones milimétricas.

- Inyección de fallos por calor: Los sistemas neuromórficos son altamente sensibles a la temperatura. Se ha documentado que ataques dirigidos mediante láseres de baja potencia o variaciones térmicas pueden forzar el ‘disparo’ de neuronas específicas, alterando la lógica de decisión del sistema sin dejar rastro en los registros de software.

Para mitigar esto, los ingenieros están desarrollando Funciones Físicas No Clonables (PUFs) basadas en memristores. Estas funciones aprovechan las variaciones de fabricación microscópicas para crear una identidad única y segura para cada chip, dificultando que un atacante pueda replicar el comportamiento de un sistema o realizar ataques de suplantación.

El papel de la seguridad neuromórfica en la infraestructura crítica

¿Por qué debería importarnos tanto? Porque la computación neuromórfica es la columna vertebral de la próxima generación de Edge Computing. Desde drones militares hasta dispositivos médicos implantables, estos chips estarán en lugares donde la latencia de la nube es inaceptable y la energía es escasa. Un marcapasos neuromórfico que pueda ser engañado mediante interferencias de radiofrecuencia para alterar el ritmo cardíaco no es una fantasía de ciencia ficción; es un riesgo real que la seguridad neuromórfica busca prevenir.

Análisis técnico: ¿Es más segura que la computación tradicional?

No es necesariamente ‘más’ segura, sino que su perfil de riesgo es distinto. Mientras que la computación tradicional sufre por desbordamientos de búfer y vulnerabilidades de software, la neuromórfica es vulnerable a la física del tiempo y la energía. Su ventaja es que, al ser asíncrona, no tiene un reloj global que los atacantes puedan explotar para sincronizar ataques masivos de la misma forma que en sistemas síncronos.

Estrategias de defensa: Blindando el cerebro digital

La defensa en este campo requiere un enfoque de co-diseño hardware-software. No basta con parches de software. Las estrategias actuales incluyen:

- Regularización de trenes de impulsos: Implementar filtros que detecten patrones de disparo que no sigan una distribución estadística natural, bloqueando intentos de inyección de ruido.

- Entrenamiento adversario específico: Entrenar a las SNN no solo con datos limpios, sino exponiéndolas deliberadamente a impulsos maliciosos durante su fase de aprendizaje para que desarrollen ‘anticuerpos’ digitales.

- Criptografía neuromórfica: El uso de redes neuronales para generar claves criptográficas dinámicas que cambian según el estado interno del chip, haciendo que el robo de claves sea prácticamente imposible mediante métodos convencionales.

En conclusión, aunque la computación neuromórfica promete llevarnos a una era de inteligencia artificial ubicua y eficiente, su éxito dependerá de nuestra capacidad para proteger estos procesos biológicamente inspirados. La seguridad ya no es solo una cuestión de bits, sino de pulsos, tiempo y resistencia eléctrica.

Preguntas Frecuentes (FAQs)

¿Qué diferencia a un ataque en computación neuromórfica de uno en IA tradicional?

En la IA tradicional (como ChatGPT o modelos de visión comunes), los ataques suelen ser manipulaciones de datos de entrada numéricos. En la computación neuromórfica, el ataque explota la dimensión temporal; es decir, no solo importa qué señal se envía, sino el momento exacto (milisegundo) en que se envía, lo que permite engañar al sistema con mucha menos energía y rastro.

¿Son los chips neuromórficos inmunes a los virus comunes?

La mayoría de los virus diseñados para arquitecturas x86 o ARM no funcionarán en un chip neuromórfico porque la forma en que se ejecutan las instrucciones es radicalmente distinta. Sin embargo, esto no los hace invulnerables; simplemente significa que requieren un nuevo tipo de malware diseñado para manipular pesos sinápticos y umbrales de disparo neuronal.

¿Cómo ayuda la seguridad neuromórfica a la privacidad de los datos?

Al permitir que el procesamiento ocurra íntegramente en el ‘borde’ (en el dispositivo local) con un consumo mínimo, se evita la necesidad de enviar datos sensibles a la nube. Esto reduce drásticamente la exposición de la información, aunque introduce el riesgo de ataques físicos directos si el dispositivo cae en manos equivocadas.